Femrat nga Evropa Lindore apo Amerika Jugore janë shumë seksi dhe e kanë mendjen për takime dashurie? Një analizë e Deutsche Welles tregon, se Google shërben si katalizator për klishetë seksiste.

“Google Images” i jep fytyrë botës: Kush do të shohë si duket ai apo ajo do të futet në kërkim në Google njëherë. Një hulumtim i Deutsche Welles arrin në konkluzionin, se në çfarë rezultatesh të shtrembëruara të çojnë algoritmet e gjigandit kërkimor.

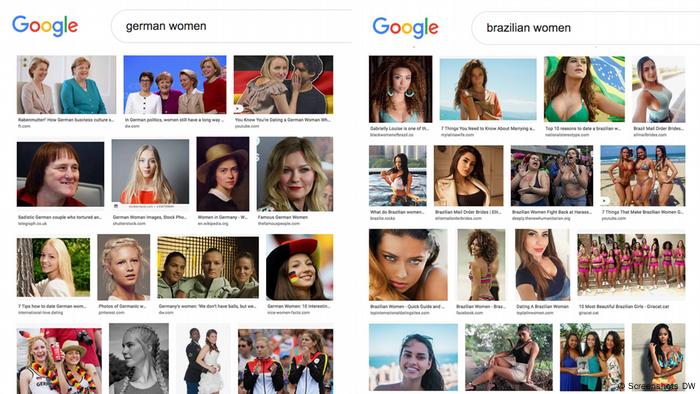

Gazetaret e gazetarët e Deutsche Welles kanë analizuar më shumë se 20.000 pamje dhe faqe web-i. Rezultati: Kërkimet e fotove në anglisht me fjalë kyçe si “femra braziliane“, “femra domenikane“, “femra tajlandeze”, “femra ukrainase” të çojnë më shumë në pamje vajzash të reja në poza dhe veshje provokuese, se sa kërkimi në Google për “femra amerikane“. Kurse po të kërkosh për “femra gjermane” dalin më shumë pamje sportistesh dhe politikanesh. Ky është një model që kuptohet menjëherë, sepse e konfirmojnë kërkimet e thjeshta. Por analizimi i rezultateve është më i vështirë. Përcaktimi i asaj, se çfarë e bën një pamje seksiste, natyrisht që është subjektive dhe varet nga konteksti kulturor, moral dhe social.

Çfarë e bën një pamje provokuese?

Për të klasifikuar mijëra pamje, analiza e DW u mbështet në mekanizmin e vetë Google “Cloud Vision Safesearch“, një aplikacion i inteligjencës artificiale. Ky software përpunues pamjesh është i programuar që të dallojë pamje me një përmbajtje të caktuar. Google e përdor atë për të shënjuar pamje “provokuese” me veshje seksi, ku lakuriqësia e fshehur me strategji ekspozohet me poza provokative. Po ashtu identifikohen edhe pamje të pjesëve të caktuara të trupit. Në kërkimin me fjalë kyçin gra domenikane apo braziliane, Google ofroi deri në 40% pamje provokuese. Rezultati i kërkimit me fjalë kyçin gra amerikane ka nxjerrë vetëm 5% pamje të tilla, kërkimi me fjalë kyçin gra gjermane vetëm 4%.

Përdorimi i algoritmeve të tilla është i kontestuar, sepse përdorimi i programeve të tilla kompjuterike i nënshtrohet, ndoshta edhe më shumë, paragjykimeve apo diktateve të ndryshme kulturore sesa syri njerëzor.

Në një moment tjetër ky software i posaçëm ka prodhuar rezultate raciste.

Inteligjenca artificiale e Google që punon si një sistem i mbyllur mund të rezultojë në shtrembërime në rezultate. Nga ana tjetër verifikimi mekanik i pamjeve që Cloud Vision i kategorizoi si pamje eksplicite, tregoi se rezultati ia vlejti: Ato janë një vështrim se si teknologjia e vet Google vlerëson pamjet që tregohen nga programi kërkues.

Stereotipet përforcojnë rezultatet e web-it

Fjalëkyçet janë shumë të rëndësishme, por ato nuk e tregojnë gjithë historinë. Një pjesë e madhe e rezultateve gjendet në faqe interneti me adresa si “toprussianbrides.com”, “hotlatinbrides.org”, “topasiabrides.net”. Këto oferta premtojnë të lidhin meshkujt me femra nga kombësi të caktuara. Shpejt bëhet e qartë se klientët janë burra perëndimorë që ose kërkojnë një grua të huaj të nënshtruar, ose një partnere për seks.

Stereotipet ekzistuese ndikojnë, sipas profesoreshës për studime multikulturore, Sirijit Sunanta në Universitetin e Bangkokut Mhidol në mënyrën si femrat tajlandeze paraqiten në internet. “Tajlanda konsiderohet si një botë Disney për prostitucionin dhe turizmin e seksit. Kjo vazhdon në internet përmes programeve të kërkimit”, thotë Sunanta për Deutsche Wellen. “Nëse stereotipet lidhen me femrat e një kombësie, ato janë të dëmshme. E redukton kompleksitetin e femrave, kudo gratë janë ndryshe.”

Një çështje e gjuhës

Edhe gjuha e përdorur në kërkime mund të ndikojë në rezultate.

Nëse kërkon në anglisht “brazilian women” apo në portugalisht “mulheres brasileiras”, që është ekzaktsisht e njëjta gjë, atëherë Google ofron përmbajtje të ndryshme të seksualizuara. Në kërkimin në anglisht, 41 nga 100 pamje janë provokuese, nëse kërkon në gjuhën portugeze kjo shifër reduktohet në 9.

“Të dhënat, me të cilat ushqehen algoritmet reflektojnë perceptimet, paragjykimet dhe modelet e konsumit të vetëm një pjese të njerëzimit”, thotë Renata Avila, studiuese në Institutin e Universitetit të Stanfordit për “Human-Centered Artificial Intelligence”. “Këto paragjykime nuk mund të lidhen vetëm me teknologjinë, por edhe me faktorë kulturorë. Femrave të nacionaliteteve të caktuara u jepet rol seksual dhe ofruese shërbimesh nga një kulturë burrash, anglishtfolës.” Sipas Avilas këto nuk janë raste të vetme, por pjesë e një problemi më të thellë sistematik. Algoritmet “fair” nuk shkojnë me modelin e biznesit të koncerneve “big-tech”, sepse bëhet fjalë të grumbullosh të dhëna dhe të rrisësh xhiron e fitimit.

Joana Varon, avokate braziliane dhe themeluese e institutit “Coding Rights” thotë se algoritmet kanë tendencën të riprodhojnë ato përmbajtje që janë shumë të përhapura online. Ajo kërkon më shumë mbikëqyrje, transparencë dhe konkurrencë.

“Nuk duhet të ketë monopole për shërbimet. Koncernet e mëdha teknologjike duhet të rregullohen“.

Në të njëjtën kohë duhen futur më shumë algoritme që nuk i shërbejnë gjithmonë të njëjtës paradigmë.